2026-03-30 日报

今日一句话

别再等云端模型了,本地部署的 llama.cpp 迭代速度快到你没时间纠结,而且,引导大模型的方式早就该换换了。

今日精选(2 条)

1. llama.cpp 再次迎来密集更新:b8586, b8585, b8583

分析:llama.cpp 几乎每天都在更新,这释放的信号很明确:本地 LLM 推理生态正在高速进化,各种优化和新功能层出不穷。对于 AI 应用开发者而言,如果你还在犹豫要不要把一部分推理工作挪到端侧或本地设备,现在是最好的试水时机。频繁跟进 llama.cpp 的版本,能让你第一时间享受到性能和稳定性的红利,这直接关乎你的成本和用户隐私。那些对延迟和 API 费用敏感的场景,端侧部署带来的可玩性和潜力,远比你盯着云端 API 价格表想象的要多。为什么选这条: 这是开发者最直接能用上的工具链更新,直接影响技术选型、性能优化,甚至是产品形态。

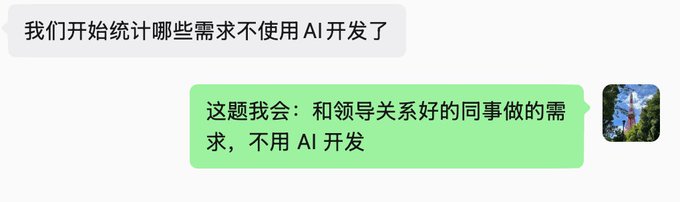

2. 通过“讲故事”让 Claude 更好地理解需求

分析:有用户为了让 Claude 更好地理解复杂代码需求,竟然选择给它讲了一段《黑客帝国》的故事。这不仅是一个有趣的尝试,更是深入理解 LLM 交互模式的绝佳案例。它明确提示我们:LLM 并非简单的指令执行器,它们能理解更抽象的语境、隐喻和类比。对于 AI 内容创作者和 prompt 工程师来说,这意味着传统的“咒语”式 prompt 正在被更具情境化、故事化的交互方式取代。尝试用人类交流的方式去构建 prompt,尤其是通过类比、故事或者丰富的语境,往往能激发模型更深层的理解和创造力。为什么选这条: 这提供了一种非传统的、但被验证有效的 prompt engineering 方法论,对内容创作者和开发者都有极强的启发性。

本周趋势

这个阶段,AI 开发者应该将一部分精力从纯粹的模型选择,转移到推理优化和高级交互技巧上。本地推理框架(如 llama.cpp)的快速迭代,意味着我们可以在性能和成本上获得更大优势,为端侧 AI 和特定场景应用开启新机会。同时,面对愈发强大的模型,如何用更“人”的方式(比如讲故事、提供丰富语境)去引导它们,是内容创作者和工程师提升输出质量、解锁模型真正潜力的关键。别在无意义的“比参数”上浪费时间了,去挖掘 LLM 的深层理解力,并真正跑起来才是正解。

今日噪音 那些关于“我不知道如何写广告文案,所以写了一篇关于我不知道如何写广告文案的文案”的自我表达,虽然创意十足,但对于真正想在 AI 领域找到工具和方法的开发者来说,并没有太多实际意义。

信息来源活跃度统计

今日总条目数: 57

Twitter/X 高活跃作者 (Top 10)

| 作者 | 条目数 | 链接 |

|---|---|---|

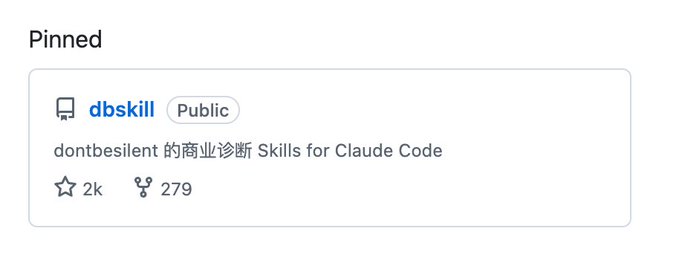

| @dontbesilent | 5 | 访问 |

| @bozhou_ai | 3 | 访问 |

| @fkysly | 2 | 访问 |

| @mryao90 | 1 | 访问 |

| @onenewbite | 1 | 访问 |

| @rork | 1 | 访问 |

| @jimmyhuli | 1 | 访问 |

| @dingyi | 1 | 访问 |

| @yahaclass | 1 | 访问 |

| @guishou_56 | 1 | 访问 |

RSS/Reddit/GitHub 来源 (Top 10)

| 来源 | 条目数 | 链接 |

|---|---|---|

| AI 洞察日报 | 7 | 访问 |

| github:openai/openai-python | 5 | 访问 |

| github:anthropics/anthropic-sdk-python | 5 | 访问 |

| github:ollama/ollama | 5 | 访问 |

| github:ggerganov/llama.cpp | 5 | 访问 |

暂无内容

暂无命中内容

暂无内容